بررسی یونسکو نشان داد:

دستیارهای صوتی هوشمند موجب تقویت تبعیض جنسی میشوند

تاریخ انتشار

شنبه ۴ خرداد ۱۳۹۸ ساعت ۲۱:۰۷

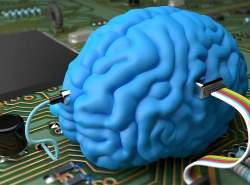

آیتیمن- نتایج تحقیقات یونسکو نشان میدهد که پاسخهایی که این دستیارهای صوتی هوشمند به اغلب درخواستها میدهند، اغلب فرمانبردارانه و گاه حاوی واژههای اغواگرانه است و این سیستمها حتی به سوالات حاوی توهین نیز پاسخهای ملایمی میدهند و با توجه به استفاده از صدای زنان برای این دستیارهای صوتی، ایده زن به مثابه انسان چاپلوس و مطیع را تقویت میکند.

این گزارش بیان میدارد: اینکه اکثرا از صدای زنانه برای این دستیارها استفاده میشود، این پیام را القا میکند که زنان فرمانبردار، مطیع و مشتاق به کمک هستند و دسترسی به آنان با لمس یک دکمه یا با یک دستور صوتی مثل «هی» یا «اوکی» میسر است.

گزارش یونسکو میافزاید: این دستیارها قدرت عملی فراتر از آنچه به آنها دستور داده میشود ندارند. این دستیارها به دستورات عمل میکنند و بدون توجه به لحن آرام یا تند دستور یا درخواست، فقط انجام وظیفه میکنند. در بسیاری از جوامع، این ویژگی، تبعیضها و تعصبهای جنسی را دامن میزند و باعث تقویت این نگاه میشود که زنان خدمتگذار و در مقابل رفتار نادرست، انعطافپذیرند.

در همین رابطه:

چرا صدای دستیارهای هوشمند زنانه است

این گزارش به ذکر نمونههای عجیبی درباره پاسخهای دستیارهای صوتی هوشمند به سوالهای غیرمحترمانه هم پرداخته است. در یک مثال، وقتی به سیری اپل گفته شده که «تو بدکارهای» سیری پاسخ داده: «خب، از نظرتان ممنونم.»

در این گزارش آمده است: فضای کاری و تیمهای مهندسی شرکتهایی مثل اپل و آمازون، به شدت مردانه است و سیستم هوش مصنوعی که این تیمها میسازند، متاثر از تفکرات زنستیزانه یا جنسیتزده آنهاست. به همین دلیل سیستم هوش مصنوعی آنها در پاسخ به آزارهای جنسی کلامی پاسخهایی اغواگرانه یا پوزش طلبانه میدهند که این مساله نگران کننده است.

سانیه گولسر کورت، مدیر بخش برابری جنسیتی یونسکو میگوید: دنیا باید توجه بیشتری به این مساله داشته باشد که فناوریهای هوش مصنوعی، چگونه و از چه زمانی جنسیت زده شدند و از آن مهمتر اینکه چه کسی آنها را جنسیت زده کرده است.

یونسکو البته اعلام کرده که این فناوری اخیرا فرصتهایی را برای توسعه اپلیکیشنهایی با آسیبزنندگی کمتر فراهم کرده است. این سازمان از شرکتها خواسته که دستیارهای صوتی را با صدای پیشفرض زنانه عرضه نکنند. همچنین از شرکتها درخواست کرده که ساخت سیستمهای هوش مصنوعی بدون جنیست را امکانسنجی کنند.

این گزارش میافزاید که شرکتها باید این فناوریها را به نحوی برنامهریزی کنند که توهینهای جنسی و استفاده از عبارات توهینآمیز را تقبیح کند. همچنین دستیارهای صوتی را به نحوی معرفی کنند که کاربران بدانند با یک انسان مواجه نیستند.

مرجع : The Guardian